AI開發的能源危機

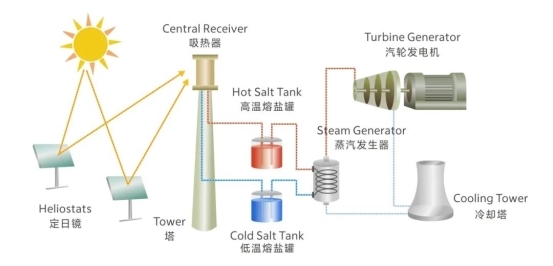

AI行業長期以來因其能源密集型實踐而受到批評。訓練像OpenAI的GPT-4或Meta的Llama這樣的大型語言模型(LLMs)需要大量的計算能力,而這些計算能力通常由消耗數千兆瓦電力的數據中心提供。例如,據報道,OpenAI每年在基礎設施上花費數十億美元,其中很大一部分用于能源成本。隨著對更強大模型的需求持續增長,AI開發產生的碳排放問題引發了越來越多的擔憂。

然而,DeepSeek正在徹底改變這一敘事。通過利用混合專家模型(Mixture-of-Experts, MoE)和多頭潛在注意力機制(Multi-Head Latent Attention, MLA)等創新架構,該公司大幅減少了訓練和部署其模型所需的計算資源。例如,DeepSeek-R1每項任務僅激活370億個參數,而競爭對手使用的參數數量高達數千億,從而顯著降低了能源消耗。

可持續AI的新范式

DeepSeek的方法以效率為核心。該公司的模型旨在最大化性能,同時最小化資源使用。例如,DeepSeek-R1的開發訓練預算僅為550萬美元,遠低于OpenAI和Meta花費的數十億美元。這種成本效益直接與能源效率掛鉤,因為更少的計算資源意味著更低的功耗和減少的排放。

此外,DeepSeek與英偉達的合作使其能夠使用性能較低的GPU,例如Nvidia H800,這些GPU比西方AI實驗室通常使用的高端芯片更加節能。通過優化其訓練流程并采用8位浮點精度(FP8)等技術,DeepSeek進一步降低了其能源需求。

受此影響,Oklo、GE Vernova、Vertiv、Eaton Corporation、Amphenol、NuScale Power Corporation和Constellation Energy等能源行業股票在交易時段內出現大幅下跌,跌幅從8%到18%不等,下跌的原因是人們擔心 DeepSeek 的能效會影響人工智能領域對高科技芯片的需求。

DeepSeek創新的全球影響

DeepSeek的成功不僅是該公司的勝利,也是地球的勝利。通過證明高性能AI可以以可持續的方式開發,DeepSeek正在迫使整個行業重新思考其方法。例如,據報道,Meta已進入“恐慌模式”,急于適應DeepSeek的成本效益和能源效率方法論。

其影響不僅限于企業競爭。DeepSeek的開源理念使全球開發者能夠在其創新基礎上進行構建,從而可能加速可持續AI實踐的采用。正如斯坦福大學AI研究主任Sarah Chen博士所指出的,DeepSeek的突破挑戰了高性能AI需要巨大計算資源的假設。

挑戰與未來之路

盡管取得了成就,DeepSeek仍面臨重大挑戰。美國對先進半導體的出口管制迫使該公司依賴性能較低的硬件,這可能會限制其進一步擴展的能力。此外,AI開發的快節奏意味著競爭對手可能會迅速趕上,特別是如果他們采用類似的以效率為中心的策略。

然而,DeepSeek對創新和可持續性的承諾使其成為推動綠色AI的領導者。隨著該公司繼續完善其模型并擴大其影響力,它可能會激發更廣泛的向能源高效AI開發的轉變,從而使行業和環境都受益。

DeepSeek的崛起標志著AI行業的一個關鍵時刻。通過證明高性能AI可以以可持續的方式開發,該公司正在挑戰現狀,并為更環保的未來鋪平道路。隨著世界應對技術進步和氣候變化的雙重挑戰,DeepSeek的創新為我們提供了一個充滿希望的愿景:當效率和可持續性成為核心時,一切皆有可能。